Das gilt es herauszufinden. Augenscheinlich scheint es aber auch nicht schlechter zu laufen. Da ich herausfinden wollte, wie gut die Verteilung der Knoten auf die unterschiedlichen Gateways klappt (uns ich im Zweifel das ganze per Knopfdruck innerhalb weniger Minuten wieder auf den vorherigen Zustand zurücksetzen lässt), habe ich das Ganze auf alle Gateways ausgerollt, die gemeinsame Domänen haben. Daher habe ich des1 und parad0x auch außen vor gelassen.

Bis jetzt sieht aber alles recht gut aus.

MPW

7. April 2017 um 08:20

795

Ah okay, ergibt Sinn mit der Verteilung und kann auch eigentlich nur besser werden.

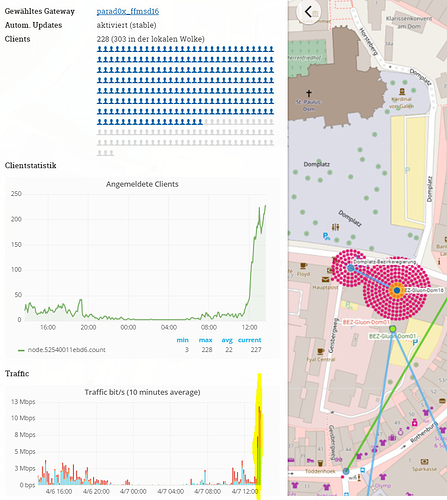

Am Domplatz hat die 5GHz Nanostation mal wieder keine Clients angenommen.

Ich habe eine neue Gruppe “RebootDaily4am” angelegt und entsprechend konfiguriert. Die beiden APs vom Domplatz werden jetzt über den AirControl täglich um 4 Uhr neu gestartet. Damit hat sich das Problem hoffentlich erledigt.

1 „Gefällt mir“

MPW

8. April 2017 um 12:55

797

@tsued für den Kartenserver freigeschaltet.

2 „Gefällt mir“

Rollen für Installation eines LAMP Stacks sowie das einrichten von osTicket gebaut.

committed 12:59PM - 10 Apr 17 UTC

Im gleichen Atemzug Rollen gebaut um Backups mittels Borg Backup einzurichten.

committed 01:00PM - 10 Apr 17 UTC

Mangels Backupziel / Konzept sichert das Ticketsystem aktuell auf meinen Server und auf eine Scaleway Kiste auf die das @Adminteam zugriff hat. Die Keys für die Backup Repos werden von Ansible unter ansible-ffms/keyfiles/borg/<quellhost>-to-<zielhost>.repokey gespeichert und mittels .gitignore Eintrag wird verhindert das diese bei GitHub landen. Dafür sollten wir uns etwas überlegen wie und wo wir diese noch sichern wollen. Die Rollen sind so gebaut das sie auf allen Systemen von uns laufen sollten. Der Grundstein für unser Backup ist also gelegt.

committed 01:04PM - 10 Apr 17 UTC

Wenn Interesse besteht wie die Rollen angewendet werden kann ich darüber gern mal an einem Mittwoch in der WZ was erzählen. Ich hab mir aber vorgenommen noch README’s zu schreiben!!11elf!

Den Docker-Container vom alten Ticketsystem auf dem Webserver habe ich gestoppt und einen rewrite für /helpdesk zur neuen URL in die nginx config eingetragen. Siehe auch:

Hallo zusammen,

ich hab grade die neue Ticketsystem VM scharfgeschaltet.

Erreichbar ist das Ticketsystem ab sofort unter https://ticket.freifunk-muensterland.de

Die alte Adresse https://freifunk-muensterland.de/helpdesk wird per rewrite an die Neue weitergeleitet damit alte Links nicht einfach sterben.

Features auf die Schnelle:

Update osTicket auf Version 1.10

Nix Doofcker Container! \o/

3 „Gefällt mir“

kgbvax

11. April 2017 um 16:01

800

Nach Aufstand den “Whos Online” aus dem Forum entfernt. Dabei die Installation vom Forum zerlegt und wieder zusammengefügt.

5 „Gefällt mir“

kgbvax

12. April 2017 um 17:08

801

2 „Gefällt mir“

kgbvax

13. April 2017 um 14:32

802

Do, 16:32 CEST: in den letzte 24h keinen Server geschrottet.

In diesem Sinne: Frohe Ostern!

7 „Gefällt mir“

Node-Stats auf das neue™ System umgestellt. Läuft noch nicht perfekt, aber die Übergangslösung ist geplatzt (Speicher voll) und daher habe ich es schon mal umgestellt. Liegt zum großen Teil schon in ansible. Ausführlicher Bericht folgt, muss jetzt mal dringend ne Runde schlafen

5 „Gefällt mir“

kgbvax

17. April 2017 um 21:13

804

Kernel & Userland vom Wiki aktualisiert.

Geht noch

2 „Gefällt mir“

“interfaces-rollen” auf remue-09 ausgerollt. Sieht so aus, als ob der reboot jetzt wieder funktioniert. Keine der Änderungen hat mich aber direkt angesprungen und gesagt “ich war der Schuldige”, daher müssen wir noch mal etwas Zeit abwarten und schauen, ob es dann immer noch funktioniert.

Hintergrund: Remue-09 hing beim reboot bzw. network restart, da es ein interface nicht abgerissen bekommen hat.

1 „Gefällt mir“

Multi-Tunneldigger nun auch auf parad0x und des1 aktiviert.

2 „Gefällt mir“

@tsued schreibenden Zugriff auf ansible-ffms und Ansible-Freifunk-Gateway gegeben.

tsued

19. April 2017 um 21:29

808

template für die “nodesmappage” und die firmwareseite nach github gepusht und ausgerollt: Karte und Firmware

4 „Gefällt mir“

MPW

19. April 2017 um 21:45

809

@Fungur und ich haben heute die neuen Ansible-Rollen für’s DNS fertiggestellt, in den Master überführt und ausgerollt.

freifunk-muensterland.net ist somit jetzt live!

3 „Gefällt mir“

MPW

23. April 2017 um 08:19

810

Kea ist auf Remü-09 abgeschmiert. Hab den Dienst neu gestartet:

root@remue-09 ~ # systemctl status kea-dhcp4.service

● kea-dhcp4.service - Kea DHCPv4 Server

Loaded: loaded (/lib/systemd/system/kea-dhcp4.service; enabled)

Active: failed (Result: exit-code) since Sun 2017-04-23 03:42:09 CEST; 6h ago

Docs: man:kea-dhcp4(8)

Process: 6730 ExecStart=/usr/local/sbin/kea-dhcp4 -c /etc/kea/kea.conf (code=exited, status=1/FAILURE)

Main PID: 6730 (code=exited, status=1/FAILURE)

Apr 23 03:42:09 remue-09 kea-dhcp4[6730]: 2017-04-23 03:42:09.786 INFO [kea-dhcp4.commands/673...ock

Apr 23 03:42:09 remue-09 kea-dhcp4[6730]: 2017-04-23 03:42:09.787 INFO [kea-dhcp4.dhcp4/6730] ...led

Apr 23 03:42:09 remue-09 kea-dhcp4[6730]: 2017-04-23 03:42:09.787 INFO [kea-dhcp4.dhcpsrv/6730...kea

Apr 23 03:42:09 remue-09 kea-dhcp4[6730]: 2017-04-23 03:42:09.870 ERROR [kea-dhcp4.dhcp4/6730] ... up

Apr 23 03:42:09 remue-09 kea-dhcp4[6730]: FATAL: the database system is starting up

Apr 23 03:42:09 remue-09 kea-dhcp4[6730]: 2017-04-23 03:42:09.870 ERROR [kea-dhcp4.dhcp4/6730] ... up

Apr 23 03:42:09 remue-09 kea-dhcp4[6730]: FATAL: the database system is starting up

Apr 23 03:42:09 remue-09 kea-dhcp4[6730]: 2017-04-23 03:42:09.871 INFO [kea-dhcp4.commands/673...ock

Apr 23 03:42:09 remue-09 systemd[1]: kea-dhcp4.service: main process exited, code=exited, stat...LURE

Apr 23 03:42:09 remue-09 systemd[1]: Unit kea-dhcp4.service entered failed state.

Hint: Some lines were ellipsized, use -l to show in full.

root@remue-09 ~ # systemctl restart kea-dhcp4.service

root@remue-09 ~ # systemctl status kea-dhcp4.service

● kea-dhcp4.service - Kea DHCPv4 Server

Loaded: loaded (/lib/systemd/system/kea-dhcp4.service; enabled)

Active: active (running) since Sun 2017-04-23 10:17:52 CEST; 1s ago

Docs: man:kea-dhcp4(8)

Main PID: 27601 (kea-dhcp4)

CGroup: /system.slice/kea-dhcp4.service

└─27601 /usr/local/sbin/kea-dhcp4 -c /etc/kea/kea.conf

Apr 23 10:17:53 remue-09 kea-dhcp4[27601]: 2017-04-23 10:17:53.028 INFO [kea-dhcp4.dhcp4/27601...800

Apr 23 10:17:53 remue-09 kea-dhcp4[27601]: 2017-04-23 10:17:53.028 INFO [kea-dhcp4.dhcp4/27601...800

Apr 23 10:17:53 remue-09 kea-dhcp4[27601]: 2017-04-23 10:17:53.028 INFO [kea-dhcp4.dhcp4/27601...800

Apr 23 10:17:53 remue-09 kea-dhcp4[27601]: 2017-04-23 10:17:53.028 INFO [kea-dhcp4.dhcp4/27601...800

Apr 23 10:17:53 remue-09 kea-dhcp4[27601]: 2017-04-23 10:17:53.029 INFO [kea-dhcp4.dhcp4/27601...800

Apr 23 10:17:53 remue-09 kea-dhcp4[27601]: 2017-04-23 10:17:53.029 INFO [kea-dhcp4.dhcp4/27601...800

Apr 23 10:17:53 remue-09 kea-dhcp4[27601]: 2017-04-23 10:17:53.029 INFO [kea-dhcp4.dhcp4/27601...800

Apr 23 10:17:53 remue-09 kea-dhcp4[27601]: 2017-04-23 10:17:53.030 INFO [kea-dhcp4.commands/27...ock

Apr 23 10:17:53 remue-09 kea-dhcp4[27601]: 2017-04-23 10:17:53.030 INFO [kea-dhcp4.dhcp4/27601...led

Apr 23 10:17:53 remue-09 kea-dhcp4[27601]: 2017-04-23 10:17:53.030 INFO [kea-dhcp4.dhcpsrv/276...kea

Hint: Some lines were ellipsized, use -l to show in full.

1 „Gefällt mir“

bind9 hat sich auf des1 auf die nase gelegt, schnell mal neu gestartet:

root@des1 ~ # systemctl status bind9.service

● bind9.service - BIND Domain Name Server

Loaded: loaded (/lib/systemd/system/bind9.service; enabled)

Drop-In: /run/systemd/generator/bind9.service.d

└─50-insserv.conf-$named.conf

Active: failed (Result: exit-code) since Mon 2017-04-24 15:36:10 CEST; 5min ago

Docs: man:named(8)

Process: 24487 ExecStop=/usr/sbin/rndc stop (code=exited, status=1/FAILURE)

Process: 8539 ExecStart=/usr/sbin/named -f -u bind (code=killed, signal=ABRT)

Main PID: 8539 (code=killed, signal=ABRT)

Apr 24 03:42:13 des1 named[8539]: automatic empty zone: view external: 102.100.IN-ADDR.ARPA

Apr 24 03:42:13 des1 named[8539]: automatic empty zone: view external: 103.100.IN-ADDR.ARPA

Apr 24 03:42:13 des1 named[8539]: automatic empty zone: view external: 104.100.IN-ADDR.ARPA

Apr 24 03:42:13 des1 named[8539]: automatic empty zone: view external: 105.100.IN-ADDR.ARPA

Apr 24 03:42:13 des1 named[8539]: automatic empty zone: view external: 106.100.IN-ADDR.ARPA

Apr 24 03:42:13 des1 named[8539]: automatic empty zone: view external: 107.100.IN-ADDR.ARPA

Apr 24 15:36:10 des1 systemd[1]: bind9.service: main process exited, code=killed, status=6/ABRT

Apr 24 15:36:10 des1 rndc[24487]: rndc: connect failed: 127.0.0.1#953: connection refused

Apr 24 15:36:10 des1 systemd[1]: bind9.service: control process exited, code=exited status=1

Apr 24 15:36:10 des1 systemd[1]: Unit bind9.service entered failed state.

root@des1 ~ # systemctl start bind9.service

root@des1 ~ # systemctl status bind9.service

● bind9.service - BIND Domain Name Server

Loaded: loaded (/lib/systemd/system/bind9.service; enabled)

Drop-In: /run/systemd/generator/bind9.service.d

└─50-insserv.conf-$named.conf

Active: active (running) since Mon 2017-04-24 15:42:13 CEST; 4s ago

Docs: man:named(8)

Process: 24487 ExecStop=/usr/sbin/rndc stop (code=exited, status=1/FAILURE)

Main PID: 25600 (named)

CGroup: /system.slice/bind9.service

└─25600 /usr/sbin/named -f -u bind

Apr 24 15:42:13 des1 named[25600]: automatic empty zone: view domaene-29: 85.100.IN-ADDR.ARPA

Apr 24 15:42:13 des1 named[25600]: automatic empty zone: view domaene-29: 86.100.IN-ADDR.ARPA

Apr 24 15:42:13 des1 named[25600]: automatic empty zone: view domaene-29: 87.100.IN-ADDR.ARPA

Apr 24 15:42:13 des1 named[25600]: automatic empty zone: view domaene-29: 88.100.IN-ADDR.ARPA

Apr 24 15:42:13 des1 named[25600]: automatic empty zone: view domaene-29: 89.100.IN-ADDR.ARPA

Apr 24 15:42:13 des1 named[25600]: automatic empty zone: view domaene-29: 90.100.IN-ADDR.ARPA

Apr 24 15:42:13 des1 named[25600]: automatic empty zone: view domaene-29: 91.100.IN-ADDR.ARPA

Apr 24 15:42:13 des1 named[25600]: using built-in root key for view domaene-30

Apr 24 15:42:13 des1 named[25600]: using built-in root key for view domaene-31

Apr 24 15:42:13 des1 named[25600]: using built-in root key for view external

kgbvax

24. April 2017 um 18:34

812

Warum hat systemd den nicht neu gestartet?

MPW

24. April 2017 um 19:00

813

Sehr gute Frage. Tut es das auch nach Neustarts? Kann man das konfigurieren?